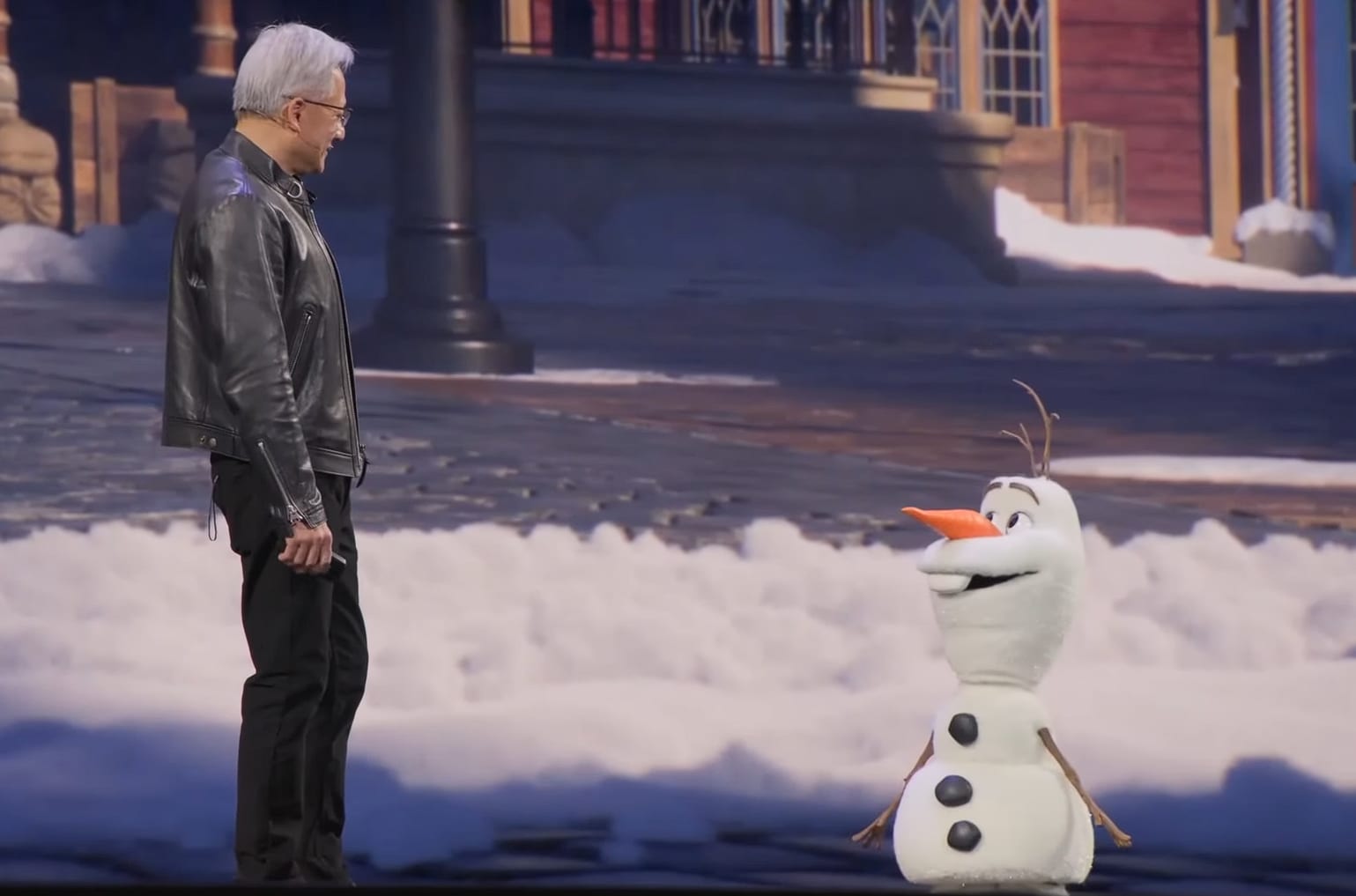

黃仁勳帶雪寶登上 GTC,NVIDIA 把實體 AI 推向迪士尼級角色機器人

NVIDIA 在 GTC 2026 專題演講尾聲把迪士尼《冰雪奇緣》的雪寶帶上舞台,這不是單純的壓軸彩蛋,而是一次很有設計感的產品展示。NVIDIA 官方 live blog 直接寫明,Olaf 是由 NVIDIA 的 實體 AI 堆疊、Newton physics engine 與 Omniverse 模擬流程驅動;黃仁勳在台上則把訊息講得更白,表示雪寶肚子裡放了 Jetson,並且是在 Omniverse 裡學會走路。對 NVIDIA 而言,這場 demo 想證明的不是「機器人可以上台」,而是角色機器人也能被納入同一套從模擬到部署的開發流程。

目前官方已確認的事實其實很集中。第一,雪寶確實被當成 GTC 2026 keynote 的實體 AI 展示案例。第二,NVIDIA 把背後技術明確綁到 Newton、Omniverse 與 Jetson。第三,黃仁勳把這段展示放在整場演講最後,和 AI factory、OpenClaw、robotics 一起收尾,顯示它在 NVIDIA 今年對外敘事裡不是邊角料,而是實體 AI 主軸的一部分。反過來看,官方目前沒有同步披露的資訊也很值得注意,例如雪寶機體規格、電池續航、成本、控制架構分工,以及任何正式的樂園部署時程。這代表現在能確定的是技術方向與平台意圖,而不是一個已公開商轉細節的迪士尼產品計畫。

雪寶 demo 目前能確認與不能確認的事

| 項目 | 已確認 | 尚未公開 |

|---|---|---|

| 展示角色 | GTC 2026 的 Olaf | 真實部署的商轉版本 |

| 技術堆疊 | Newton、Omniverse、Jetson | 控制架構分工 |

| 平台意義 | 實體 AI 主軸展示 | 成本、續航、時程 |

| 產業判斷 | 角色機器人可納入同一套工具鏈 | 是否可大規模落地 |

真正讓這個展示有含金量的地方,在於雪寶不是一台普通雙足機器人。工業機器人可以把目標縮小成搬運、焊接、巡檢,但迪士尼角色機器人要多解一層問題: 它不只要穩定移動,還要維持角色感、節奏感與觀眾熟悉的肢體語言。這也是為什麼去年 GTC NVIDIA、Google DeepMind 與 Disney Research 宣布推出開源 Newton 時,就把迪士尼機器人角色平台列為首批重要場景。當時官方已經說明,Disney Research 會率先用 Newton 推進角色機器人,並把 Kamino 這類處理複雜閉環機構的模擬能力帶進整個專案。今年 GTC 進一步把這條線往前推: Newton 1.0 GA 已能處理 locomotion 與 contact-rich manipulation,Kamino 用來處理複雜腿部與連桿結構,MuJoCo Warp 則被 NVIDIA 描述成可把 locomotion 與 manipulation 訓練加速到 GPU 規模。換句話說,雪寶上台的意義不是「NVIDIA 做了一隻可愛機器人」,而是它把先前還偏研究與工具鏈的 Newton 敘事,變成觀眾一眼就看得懂的角色級展示。

這背後還連到 NVIDIA 在 GTC 2026 反覆強調的一個更大命題: 機器人的瓶頸不該再只是現實世界資料不足,而要盡量被改寫成算力與模擬能力問題。The Decoder 對今年 GTC 的整理就把這點說得很直接,認為 NVIDIA 正試圖把 robotics 的 data problem 轉成 compute problem。這和 NVIDIA 自家開發者部落格的說法高度一致。官方在介紹 world model 與 Cosmos 時,重點不是抽象地講「更懂物理世界」,而是給出更具體的工具更新,例如 Cosmos Predict 2.5 可生成最長 30 秒序列、宣稱在特定後訓練情境下可達最多 10 倍更高準確度,Cosmos Reason 2 則把長上下文支援拉到 256K input tokens,並強化物件定位與時序推理。這些規格不直接屬於雪寶本體,但它們說明了 NVIDIA 為何能把舞台上的角色機器人 demo,連回資料生成、感知推理、模擬驗證與邊緣 推論 的一整條平台故事。

NVIDIA 這套故事也不是只說給迪士尼聽。GTC 2026 同一批官方材料裡,NVIDIA 一邊展示雪寶,一邊公布 ABB、KUKA、Universal Robots、Hexagon Robotics、醫療機器人團隊與自駕車夥伴都在接入它的實體 AI 工具鏈。站內前一週寫過 Jensen Huang 發表 AI Is a 5-Layer Cake,NVIDIA 用五層架構定義 AI 基礎設施,當時 NVIDIA 就已把能源、晶片、基礎設施、模型與應用綁成一張圖。雪寶這次上台,等於把那張圖最難說服人的一塊補上: 如果連高度角色化、帶表演屬性的機器人都能用同一套模擬與 GPU 工具鏈訓練,那麼工業、自駕、醫療與娛樂機器人之間的共用平台想像就更容易成立。

但這場展示也有一個很重要的邊界要先講清楚。就目前公開資訊看,NVIDIA 證明的是「角色機器人可被納入現代實體 AI 工具鏈」,不是「迪士尼樂園已經準備大規模部署雪寶」。黃仁勳在台上確實把這個方向描述成迪士尼樂園的未來模樣,可是至少在目前官方新聞與技術文章裡,還看不到完整商用部署的時間表、運營模式、可靠度指標,或長時間與遊客互動的安全設計細節。對投資人、開發者與產業觀察者來說,這個差異不能混在一起看。前者是技術路線成立,後者則是產品與營運落地,兩者之間還隔著不少工程與商業驗證。

所以,GTC 2026 這場雪寶亮相最值得記住的,不是黃仁勳又做了一段會在社群爆紅的舞台互動,而是 NVIDIA 終於把 具身 AI、模擬、強化學習、數位孿生 與邊緣部署,壓縮成一個大眾也能理解的畫面。接下來真正要追的,是 Disney Research 會不會釋出更多角色 locomotion 的技術細節、Newton 社群會不會出現更多可重現的角色機器人案例,以及 NVIDIA 能不能把這條從舞台展示到實際部署的路,走成一個比 demo 更穩定的產業標準。